Chatbots IA à la maison avec Ollama 🚀 5 avantages incroyables.

Principales conclusions

- En exécutant un bot d’IA local, vous bénéficiez d’avantages en matière de confidentialité des données et d’utilisation hors ligne. 🤖

- Tenez compte des paramètres, des jetons et de la taille de l’ensemble de données lorsque vous utilisez des modèles de langage volumineux.

- Instala Ollama para correr modelos de IA en tu dispositivo y experimentar fácilmente con diferentes modelos. 🛠️

¡. Es fácil de usar, se ejecuta en tu propio appareil et vous permet de créer des solutions plus intelligentes et plus personnalisées, aucune programmation requise ! 🌟

Pourquoi utiliser un Local Bot ?

Que vous soyez totalement immergé dans la mode de la IA Que vous pensiez que tout cela n'est qu'une histoire à dormir debout ou non, les outils d'IA comme ChatGPT et Claude sont là pour rester. Exécutez un Chatbot IA local offre des avantages concrets :

- Confidentialité des données : Au gérer un chatbot localement, vous conservez vos données sur votre appareil. Cela signifie que vos informations privées ne sont pas envoyées à des serveurs externes ou au cloud.

- Utilisation hors ligne : L'utilisation d'un chatbot IA local vous permet d'y accéder hors ligne à Internet, ce qui est très utile si votre connexion est limitée ou peu fiable. 🛡️

- Personnalisation: Vous pouvez l'adapter à vos besoins spécifiques ou l'intégrer à des ensembles de données spécifiques, contribuant ainsi à rendre le chatbot adapté à vos besoins. 💡

- Rentabilité : De nombreux services d’IA basés sur le cloud facturent l’utilisation de leur API ou ont des frais d’abonnement. L'exécution d'un modèle localement est gratuite. 💸

- Latence plus faible : Avec un modèle d’IA local, il n’est pas nécessaire d’effectuer des requêtes auprès de serveurs externes. Cela peut considérablement accélérer le temps de réponse du chatbot, offrant une expérience plus fluide et plus agréable. ⏱️

- Expérimentation et apprentissage : L’exécution d’un chatbot local vous donne plus de liberté pour expérimenter les paramètres, affiner le modèle ou tester différentes versions de l’IA. C'est idéal pour les développeurs et les passionnés qui souhaitent acquérir une expérience pratique de la technologie de l'IA. 🔍

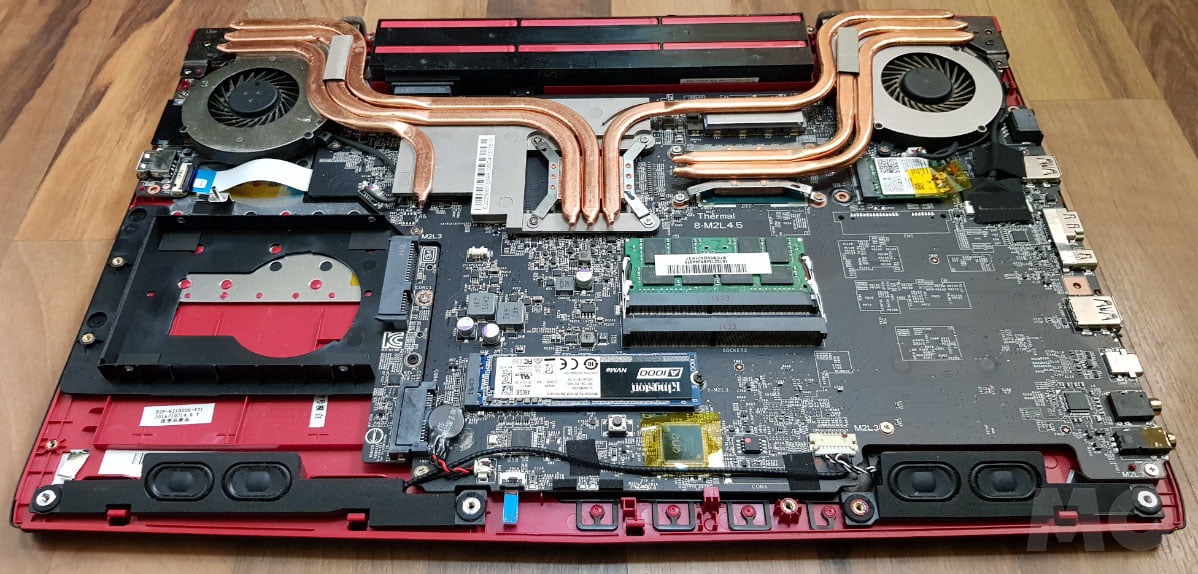

Considérations clés lors de l'utilisation de grands modèles linguistiques

Un grand modèle de langage d’IA (LLM), grand ou petit, peut être gourmand en ressources. Ils nécessitent souvent du matériel puissant comme des GPU pour effectuer le gros du travail, une grande quantité de RAM pour conserver les modèles en mémoire et un stockage important pour les ensembles de données en croissance.

Les paramètres sont des valeurs que le modèle ajuste pendant l'entraînement. Plus de paramètres conduisent à une meilleure compréhension du langage, mais des modèles plus grands nécessitent plus de ressources et de temps. Pour les tâches plus simples, des modèles avec moins de paramètres, tels que 2B (milliard) ou 8B, peuvent être suffisants et plus rapides à entraîner.

Les jetons sont des fragments de texte que le modèle traite. La limite de jetons d'un modèle affecte la quantité de texte qu'il peut gérer à la fois, donc des capacités plus grandes permettent une meilleure compréhension des entrées complexes.

Enfin, la taille de l’ensemble de données est importante. Les ensembles de données plus petits et plus spécifiques, tels que ceux utilisés pour les robots de service client, s'entraînent plus rapidement. Les ensembles de données plus volumineux, bien que plus complexes, nécessitent plus de temps de formation. Le réglage des modèles pré-entraînés avec des données spécialisées est souvent plus efficace que de partir de zéro.

Comment configurer et exécuter Ollama

Ollama est une plateforme d'IA facile à utiliser qui vous permet d'exécuter des modèles d'IA localement sur votre ordinateur. Voici comment installer et démarrer :

Installer Ollama

Puedes instalar Ollama en Linux, macOS y Windows.

Pour macOS et Windows, Téléchargez le programme d'installation depuis le site Web d'Ollama et suivez les étapes d'installation comme n'importe quelle autre application.

Sous Linux, ouvrez le terminal et exécutez :

curl -fsSL https://ollama.com/install.sh | shUna vez instalado, estarás listo para comenzar a experimentar con Chatbots IA en casa.

Exécution de votre premier modèle d'IA Ollama

Une fois installer Ollama, ouvrir le terminal sous Linux ou macOS, ou PowerShell sur Windows. Pour commencer, nous allons exécuter un LLM populaire développé par Meta appelé Llama 3.1 :

ollama run llama3.1Comme c'est la première fois que vous utilisez Ollama, il recherchera le modèle lama 3.1, l'installera automatiquement, puis vous invitera à commencer à poser des questions. 🗣️

Exécution d'autres modèles

Bien que le Llama 3.1 soit le modèle préféré de la plupart des personnes qui débutent avec Ollama, il existe d'autres modèles que vous pouvez essayer. Si vous trouvez un modèle qui, selon vous, pourrait fonctionner pour vous, votre matériel et vos besoins spécifiques, exécutez simplement la même commande que pour Llama 3.1, par exemple, si vous souhaitez télécharger Phi 3 :

ollama run phi3Comme auparavant, si c'est la première fois que vous utilisez le modèle, Ollama le recherchera, l'installera et l'exécutera automatiquement. ⚙️

Autres commandes que vous voudrez connaître

Ollama dispose de plusieurs commandes supplémentaires que vous pouvez utiliser, mais en voici quelques-unes que nous pensons que vous trouverez intéressantes :

- Les modèles occupent un espace disque important. Pour libérer de l'espace, supprimez les modèles inutilisés avec :

ollama rm nom du modèle- Pour afficher les modèles que vous avez déjà téléchargés, exécutez :

liste d'ollama- Pour voir quels modèles fonctionnent et consommant des ressources, utilisations :

Ollam ps- Si vous souhaitez arrêter un modèle pour libérer des ressources, utilisez :

arrêt ollama- Si vous voulez voir le reste des commandes d'Ollama, exécutez :

ollama --aideChoses que vous pouvez essayer

Si vous avez hésité à essayer les chatbots IA en raison de préoccupations concernant sécurité ou confidentialité, c'est votre moment de franchir le pas ! Voici quelques idées pour vous aider à démarrer :

- Créez une liste de choses à faire : demandez à Ollama de générer une liste de choses à faire pour la journée. ✔️

- Planification du déjeuner de la semaine : Besoin d’aide pour planifier vos repas ? Demandez à Ollama. 🍽️

- Résumer un article : Vous manquez de temps ? Collez un article dans Ollama et demandez un résumé. 📄

N'hésitez pas à expérimenter et à découvrir comment Ollama peut vous aider dans la résolution de problèmes, la créativité ou les tâches quotidiennes. 🚀

Félicitations pour avoir configuré votre propre chatbot IA à la maison ! Vous avez fait vos premiers pas dans le monde passionnant de l'IA, en créant un outil puissant adapté à vos besoins spécifiques. En exécutant le modèle localement, vous avez assuré une plus grande confidentialité, des réponses plus rapides et la liberté d'affiner l'IA pour des tâches personnalisées. 🌟