Ollama で自宅で AI チャットボットを活用 🚀 5 つの驚くべきメリット。

主な結論

- ローカル AI ボットを実行することで、データのプライバシーとオフライン使用のメリットが得られます。 🤖

- 大規模な言語モデルを使用する場合は、パラメーター、トークン、データセットのサイズを考慮してください。

- Instala Ollama para correr modelos de IA en tu dispositivo y experimentar fácilmente con diferentes modelos. 🛠️

¡. Es fácil de usar, se ejecuta en tu propio デバイスをよりスマートに、よりパーソナライズされたソリューションにすることができますプログラミングは必要ありません! 🌟

ローカル ボットを実行する理由は何ですか?

あなたがファッションに夢中になっているかどうか IA それがすべて作り話だと思うかどうかは別として、ChatGPT や Claude のような AI ツールは今後も存在し続けるでしょう。実行する AIチャットボット ローカルには具体的なメリットがあります:

- データのプライバシー: へ チャットボットをローカルで管理する、データはデバイス上に保存されます。つまり、個人情報は外部サーバーやクラウドに送信されません。

- オフライン使用: ローカルAIチャットボットを使用すると、オフラインでもアクセスできます インターネットへこれは、接続が制限されていたり、信頼できない場合に非常に便利です。 🛡️

- パーソナライゼーション: 特定のニーズに合わせてカスタマイズしたり、特定のデータ セットと統合したりすることで、チャットボットをニーズに適したものにすることができます。 💡

- コスト効率: 多くのクラウドベースの AI サービスでは、API の使用料やサブスクリプション料金が課金されます。モデルをローカルで実行するのは無料です。 💸

- 低レイテンシ: ローカル AI モデルを使用すると、外部サーバーにリクエストを行う必要はありません。これにより、チャットボットの応答時間が大幅に短縮され、よりスムーズで楽しいエクスペリエンスが提供されます。 ⏱️

- 実験と学習: ローカル チャットボットを実行すると、設定を試したり、モデルを微調整したり、AI のさまざまなバージョンをテストしたりする自由度が高まります。これは、AI テクノロジーを実際に体験したい開発者や愛好家に最適です。 🔍

大規模言語モデルを使用する際の重要な考慮事項

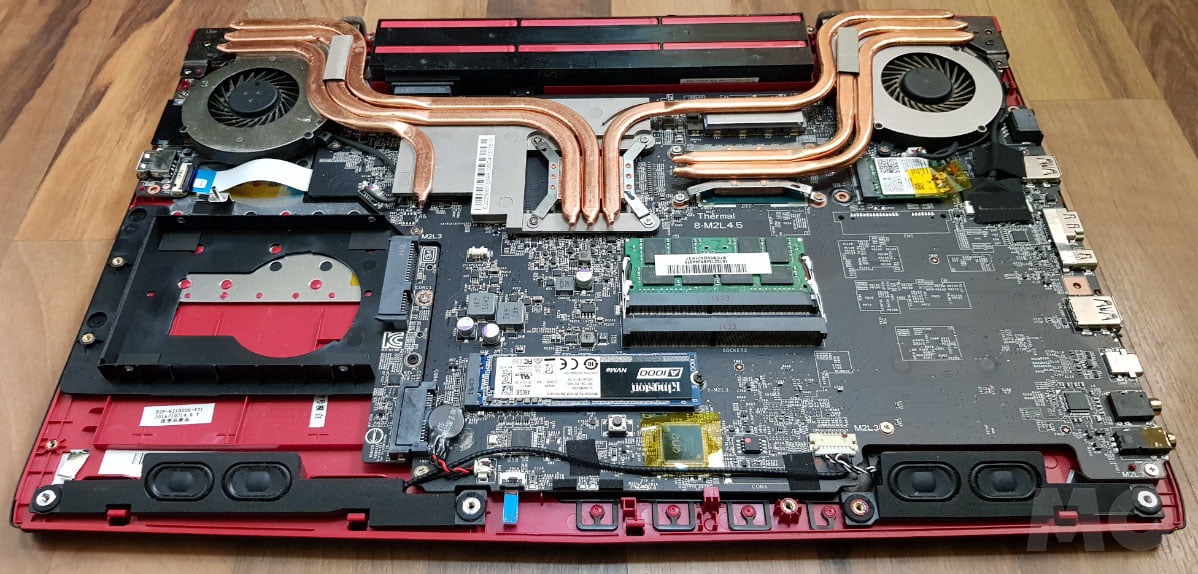

大規模な AI 言語モデル (LLM) は、規模に関係なく、大量のリソースを消費する可能性があります。多くの場合、重い処理を実行するには GPU などの強力なハードウェア、モデルをメモリ内に保持するための大量の RAM、そして増大するデータセット用の大きなストレージが必要になります。

パラメータは、モデルがトレーニング中に調整する値です。パラメータが増えると言語理解が向上しますが、モデルが大きくなるとより多くのリソースと時間が必要になります。より単純なタスクの場合、2B(十億)や 8B などのパラメータの少ないモデルで十分であり、トレーニングも速くなります。

トークンは、モデルが処理するテキストの断片です。モデルのトークン制限は、一度に処理できるテキストの量に影響するため、容量が大きいほど複雑な入力をより適切に理解できるようになります。

最後に、データセットのサイズが重要です。顧客サービス ボットに使用されるような、より小規模でより具体的なデータ セットは、より速くトレーニングされます。データ セットが大きくなるほど、複雑になり、トレーニングに時間がかかります。多くの場合、専門的なデータを使用して事前トレーニング済みのモデルを調整する方が、最初から始めるよりも効率的です。

Ollama の設定と実行方法

Ollama は、コンピューター上で AI モデルをローカルに実行できる、使いやすい AI プラットフォームです。インストールして開始する方法は次のとおりです。

Ollamaをインストールする

Ollama は Linux、macOS、Windows にインストールできます。

macOSおよびWindowsの場合、 Ollamaのウェブサイトからインストーラーをダウンロードします 他のアプリケーションと同様にインストール手順に従います。

Linux では、ターミナルを開いて次のコマンドを実行します。

curl -fsSL https://ollama.com/install.sh |シュUna vez instalado, estarás listo para comenzar a experimentar con AIチャットボット en casa.

最初の Ollama AI モデルを実行する

一度 Ollamaをインストールし、Linuxでターミナルを開きます または macOS、または Windows 上の PowerShell。まず、Meta が開発した人気の LLM、Llama 3.1 を実行します。

ollama 実行 llama3.1Ollama を初めて使用する場合は、llama 3.1 モデルが検索され、自動的にインストールされてから、質問を開始するように求められます。 🗣️

他のモデルの実行

Llama 3.1 は Ollama を使い始めたばかりのほとんどの人にとって好ましいモデルですが、他にも試すことのできるモデルがあります。自分、ハードウェア、特定のニーズに合うと思われるモデルが見つかった場合は、Llama 3.1 の場合と同じコマンドを実行するだけです。たとえば、Phi 3 をダウンロードする場合は次のようになります。

オラマランファイ3これまでと同様に、モデルを初めて使用する場合は、Ollama が自動的にモデルを検索し、インストールして実行します。 ⚙️

知っておきたいその他のコマンド

Ollama には使用できる追加コマンドがいくつかありますが、ここでは興味深いと思われるコマンドをいくつか紹介します。

- モデルは大量のディスク領域を占有します。スペースを解放するには、次の方法で未使用のテンプレートを削除します。

ollama rm モデル名- すでにダウンロードしたテンプレートを表示するには、次のコマンドを実行します。

オルラマリスト- どのモデルが実行されているかを確認するには 資源を消費する、使用法:

オラム ps- モデルを停止してリソースを解放する場合は、次を使用します。

オルラマストップ- Ollama の残りのコマンドを確認するには、次のコマンドを実行します。

ollama --ヘルプ試せること

AIチャットボットを試すのをためらっているなら、 セキュリティやプライバシー、思い切って行動する時が来ました!始めるにあたって、いくつかのアイデアをご紹介します:

- ToDo リストを作成する: Ollama にその日の ToDo リストを生成するように依頼します。 ✔️

- 今週のランチの計画: 食事の計画にサポートが必要ですか?オラマに聞いてください。 🍽️

- 記事の要約: 時間が足りない?記事を Ollama に貼り付けて、要約を要求します。 📄

ぜひ自由に実験して、Ollama が問題解決、創造性、日常のタスクにどのように役立つかを発見してください。 🚀

ご自宅に AI チャットボットを設置していただき、ありがとうございます。あなたは AI の刺激的な世界への第一歩を踏み出し、特定のニーズに合わせた強力なツールを作成しました。モデルをローカルで実行することで、プライバシーが強化され、応答が速くなり、カスタム タスクに合わせて AI を自由に微調整できるようになります。 🌟