Ollama와 함께 집에서 사용하는 AI 챗봇 🚀 5가지 놀라운 이점

주요 결론

- 로컬 AI 봇을 실행하면 데이터 개인 정보 보호와 오프라인 사용 이점을 얻을 수 있습니다. 🤖

- 대규모 언어 모델을 사용하는 경우 매개변수, 토큰 및 데이터 세트 크기를 고려하세요.

- Instala Ollama para correr modelos de IA en tu dispositivo y experimentar fácilmente con diferentes modelos. 🛠️

¡. Es fácil de usar, se ejecuta en tu propio 장치를 사용하면 보다 스마트하고 개인화된 솔루션을 만들 수 있습니다.프로그래밍이 필요 없습니다! 🌟

로컬 봇을 운영하는 이유는 무엇인가요?

당신이 패션에 완전히 몰두하고 있든 IA 이게 다 허황된 이야기라고 생각하든 그렇지 않든, ChatGPT와 Claude 같은 AI 도구는 앞으로도 계속 사용될 것입니다. 실행하다 AI 챗봇 지역적으로는 구체적인 이점이 있습니다:

- 데이터 개인정보 보호: 에 로컬로 챗봇 관리하기, 귀하의 데이터는 귀하의 기기에 보관됩니다. 즉, 귀하의 개인정보는 외부 서버나 클라우드로 전송되지 않습니다.

- 오프라인 사용: 로컬 AI 챗봇을 사용하면 오프라인에서도 액세스할 수 있습니다. 인터넷으로이 기능은 연결이 제한적이거나 신뢰할 수 없는 경우 매우 유용합니다. 🛡️

- 개인화: 특정 요구 사항에 맞게 챗봇을 조정하거나 특정 데이터 세트와 통합하여 요구 사항에 적합한 챗봇을 만들 수 있습니다. 💡

- 비용 효율성: 많은 클라우드 기반 AI 서비스는 API 사용에 대해 요금을 청구하거나 구독료를 부과합니다. 모델을 지역적으로 실행하는 것은 무료입니다. 💸

- 더 낮은 지연 시간: 로컬 AI 모델을 사용하면 외부 서버에 요청할 필요가 없습니다. 이를 통해 챗봇의 응답 시간이 크게 단축되어 더욱 원활하고 즐거운 경험을 제공할 수 있습니다. ⏱️

- 실험과 학습: 로컬 챗봇을 운영하면 설정을 실험하고, 모델을 미세 조정하고, AI의 다양한 버전을 테스트할 수 있는 자유가 더 커집니다. 이는 AI 기술을 직접 경험하고 싶은 개발자와 애호가에게 이상적입니다. 🔍

대규모 언어 모델을 사용할 때의 주요 고려 사항

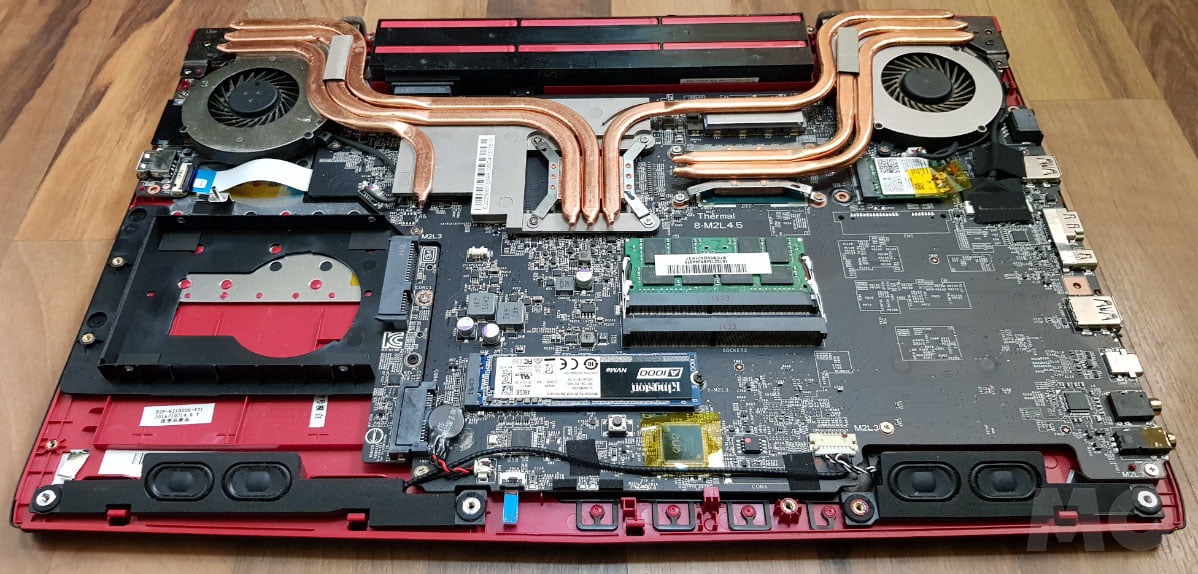

대규모 AI 언어 모델(LLM)은 크거나 작거나 관계없이 많은 리소스를 필요로 할 수 있습니다. 이러한 모델들은 종종 무거운 작업을 처리하기 위한 GPU와 같은 강력한 하드웨어, 모델을 메모리에 보관하기 위한 대용량 RAM, 그리고 증가하는 데이터 세트를 위한 상당한 저장 공간이 필요합니다.

매개변수는 모델이 훈련하는 동안 조정하는 값입니다. 매개변수가 많을수록 언어 이해도가 높아지지만, 모델이 클수록 더 많은 리소스와 시간이 필요합니다. 보다 간단한 작업의 경우 2B(10억) 또는 8B와 같이 매개변수가 적은 모델이 충분하고 학습 속도가 더 빠를 수 있습니다.

토큰은 모델이 처리하는 텍스트 조각입니다. 모델의 토큰 제한은 한 번에 처리할 수 있는 텍스트 양에 영향을 미치므로, 용량이 클수록 복잡한 입력을 더 잘 이해할 수 있습니다.

마지막으로, 데이터 세트의 크기가 중요합니다. 고객 서비스 봇에 사용되는 것과 같은 더 작고 구체적인 데이터 세트는 더 빨리 훈련됩니다. 더 큰 규모의 데이터 세트는 더 복잡하지만, 학습하는 데 더 많은 시간이 필요합니다. 전문화된 데이터로 사전 훈련된 모델을 튜닝하는 것이 처음부터 시작하는 것보다 효율적인 경우가 많습니다.

Ollama 설정 및 실행 방법

Ollama는 컴퓨터에서 로컬로 AI 모델을 실행할 수 있는 사용하기 쉬운 AI 플랫폼입니다. 설치 및 시작 방법은 다음과 같습니다.

Ollama 설치

Ollama는 Linux, macOS, Windows에 설치할 수 있습니다.

macOS 및 Windows의 경우 Ollama 웹사이트에서 설치 프로그램을 다운로드하세요 다른 애플리케이션과 마찬가지로 설치 단계를 따르세요.

Linux에서는 터미널을 열고 다음을 실행합니다.

curl -fsSL https://ollama.com/install.sh | 쉿Una vez instalado, estarás listo para comenzar a experimentar con AI 챗봇 en casa.

첫 번째 Ollama AI 모델 실행

한 번 Ollama를 설치하고 Linux에서 터미널을 엽니다. 또는 macOS나 Windows의 PowerShell. 시작하기 위해 Meta에서 개발한 Llama 3.1이라는 인기 있는 LLM을 실행해 보겠습니다.

올라마 런 라마3.1Ollama를 처음 사용하는 경우, Ollama 3.1 모델을 검색하여 자동으로 설치한 다음 질문을 하라는 메시지가 표시됩니다. 🗣️

다른 모델 실행

Llama 3.1은 Ollama를 처음 사용하는 대부분의 사람들에게 선호되는 모델이지만, 시도해 볼 수 있는 다른 모델도 있습니다. 귀하, 귀하의 하드웨어 및 특정 요구 사항에 적합할 것 같은 모델을 찾았다면 Llama 3.1에서 실행한 것과 동일한 명령을 실행하기만 하면 됩니다. 예를 들어 Phi 3를 다운로드하려는 경우:

올라마 런 파이3이전과 마찬가지로, 해당 모델을 처음 사용하는 경우 Ollama가 자동으로 해당 모델을 검색하여 설치하고 실행합니다. ⚙️

당신이 알고 싶어하는 다른 명령들

Ollama에는 사용할 수 있는 추가 명령이 여러 가지 있지만, 흥미로울 것 같은 명령 몇 가지를 소개하겠습니다.

- 모델은 상당한 디스크 공간을 차지합니다. 공간을 확보하려면 다음을 사용하여 사용하지 않는 템플릿을 삭제하세요.

올라마 rm 모델명- 이미 다운로드한 템플릿을 보려면 다음을 실행하세요.

올라마 리스트- 어떤 모델이 실행 중인지 확인하려면 자원 소모, 사용:

올람 ps- 리소스를 해제하기 위해 모델을 중지하려면 다음을 사용하세요.

올라마 정류장- Ollama의 나머지 명령을 보려면 다음을 실행하세요.

ollama --도움말시도할 수 있는 것들

AI 챗봇 도입을 주저하고 계셨다면 보안 또는 개인 정보 보호, 이제 뛰어들 시간입니다! 시작하기 위한 몇 가지 아이디어는 다음과 같습니다.

- 할 일 목록 만들기: Ollama에게 하루 할 일 목록을 생성해 달라고 요청하세요. ✔️

- 이번 주 점심 식사 계획: 식사 계획에 도움이 필요하신가요? 올라마에게 물어보세요. 🍽️

- 기사 요약: 시간이 부족하신가요? Ollama에 기사를 붙여넣고 요약을 요청하세요. 📄

자유롭게 실험하고 Ollama가 문제 해결, 창의성 또는 일상 업무에 어떻게 도움을 줄 수 있는지 알아보세요. 🚀

집에서 AI 챗봇을 만들어보신 것을 축하드립니다! 여러분은 흥미진진한 AI 세계로 첫발을 내디뎠고, 여러분의 특정 요구 사항에 맞춰 제작된 강력한 도구를 만들었습니다. 모델을 로컬에서 실행함으로써 개인 정보 보호가 강화되고, 대응 속도가 빨라지며, 사용자 정의 작업에 맞게 AI를 세부 조정할 수 있는 자유가 보장됩니다. 🌟